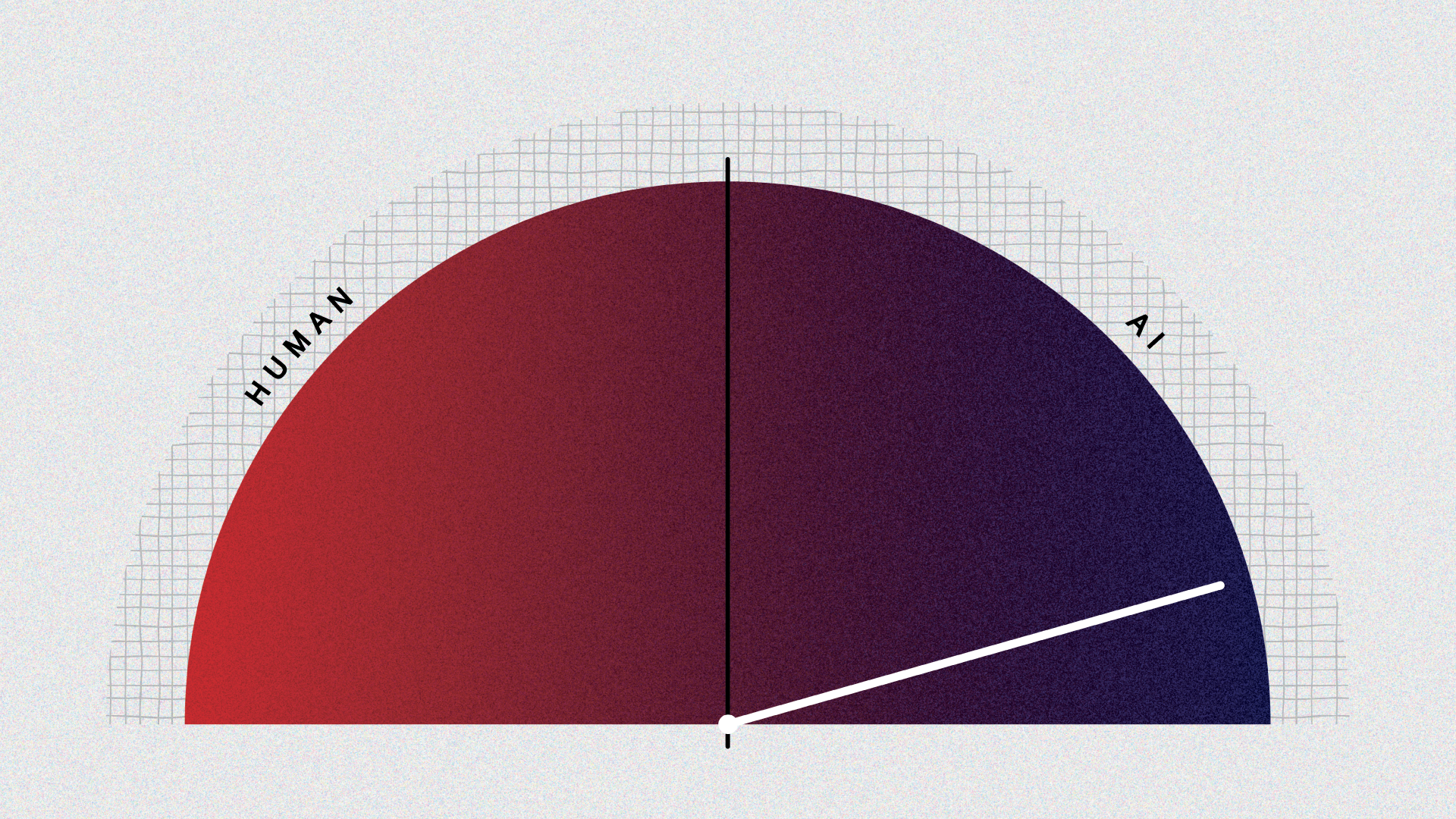

Vještačka inteligencija nam je za petama

Spojler: Uzbudljivo je (i pomalo zastrašujuće)

Gentiana Paçarizi

Gentiana Paçarizi je menadžerica-urednica K2.0.. Završila je diplomski studij novinarstva i odnosa s javnošću na Univerzitetu u Prištini „Hasan Prishtina“.

Ovaj članak je napisan na engleskom.